De Autoriteit Persoonsgegevens (AP) waarschuwt voor een toename van datalekken die ontstaan door het gebruik van AI-chatbots zoals ChatGPT, Claude en Gemini. Volgens de privacywaakhond zijn er dit jaar tientallen meldingen binnengekomen van organisaties die ongemerkt gevoelige informatie deelden met deze systemen, schrijft het Financieele Dagblad.

Een recent incident bij de gemeente Eindhoven laat zien hoe snel het mis kan gaan: tijdens een intern onderzoek bleken medewerkers persoonlijke gegevens zoals cv’s, jeugdzorgdocumenten en interne verslagen te hebben ingevoerd in openbare chatbots. De gemeente heeft sindsdien de toegang tot zulke AI-diensten geblokkeerd en OpenAI gevraagd de bestanden te verwijderen.

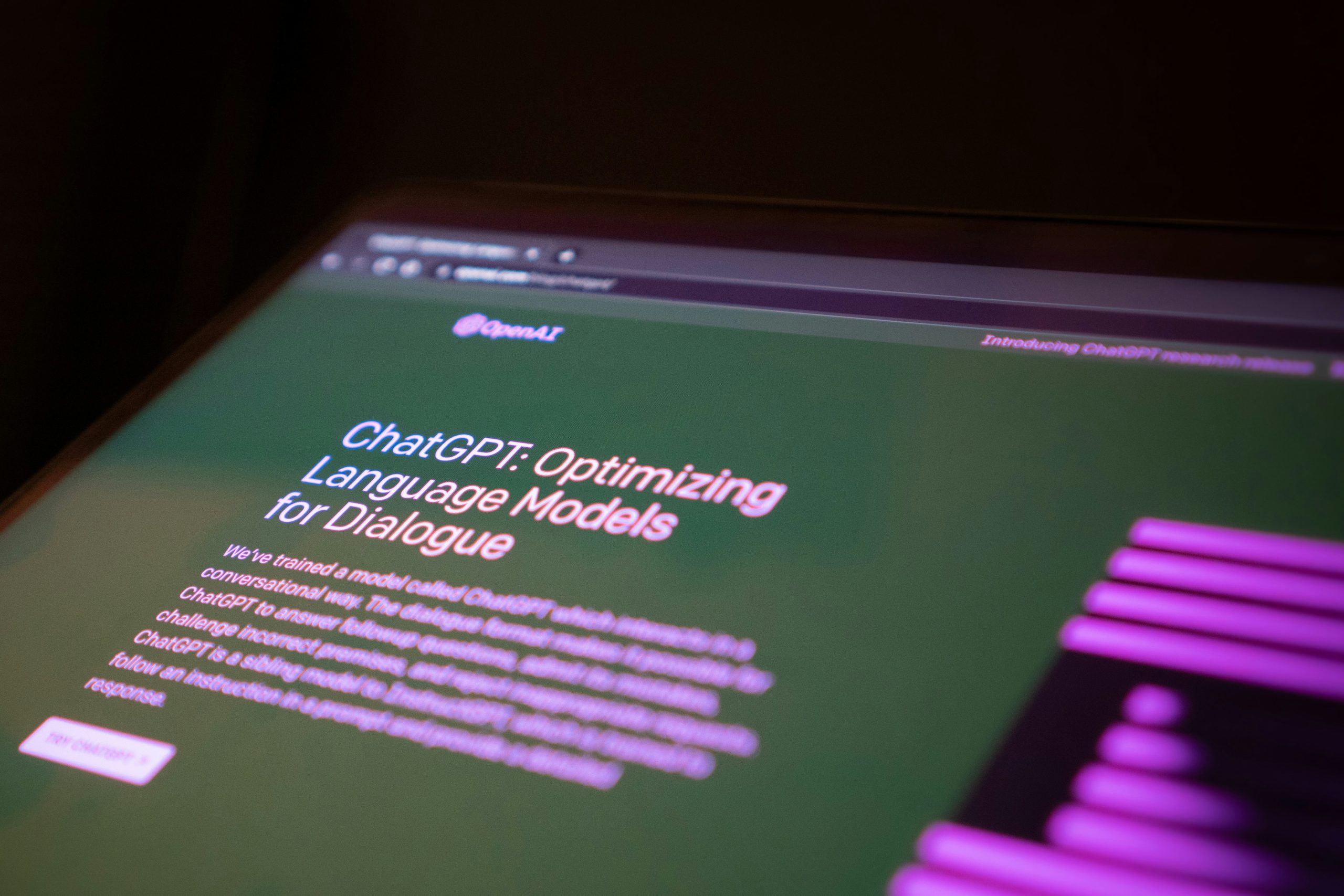

Volgens de AP en privacyjurist Stephan Mulders ontstaan veel van deze lekken doordat werknemers op eigen initiatief met gratis AI-tools experimenteren, ook wel ‘shadow AI’ genoemd. Deze versies slaan de ingevoerde data op en gebruiken die mogelijk om modellen te trainen, waardoor vertrouwelijke details opnieuw in antwoorden kunnen opduiken.

Bedrijven kunnen dit risico beperken door websites van gratis AI-diensten te blokkeren, veilige alternatieven aan te bieden en duidelijke richtlijnen vast te leggen. Mulders wijst erop dat organisaties sinds de invoering van de AI Act bovendien verplicht zijn om trainingen te geven over veilig gebruik van kunstmatige intelligentie. Toch verwacht hij dat bewustwording tijd zal kosten – net als destijds bij de invoering van de AVG.